벤처 투자, 그리고 AI, AI 윤리에 관심을 가지고 들여다보다 보니, ESG 때와도 맥이 일정부분 닿는듯한 영역이 있다. 벤처 투자자에 대한 AI 윤리에의 책임과 관련한 영역이다. 실리콘밸리 VC인 Spatial capital 은 AI ethics in VC 라는 행사도 진행하고, 투자자가 윤리와 수익성 간 균형을 어떻게 잡아야하는지에 대해 논했다고 밝히기도 했다.

AI 산업, 특히 최근의 생성AI 분야가 급성장한데에는 막대한 벤처 투자가 뒷받침 되었기 때문에 이 산업의 중요한 축이라고 할 수 있을 것이다. 그렇다면 당연히 어느정도 자신들의 포트폴리오 기업이 개발하고 서비스하는 AI 기술과 프로덕트에 대한 윤리적 문제에 책임을 져야 할까. (책임을 져야한다는 데에는 어느정도 컨센서스가 있는 것 같다. )그렇다면 어떻게 해야할까. 이것저것 살펴봤던 내용들을 정리해봤다.

벤처캐피탈에는 AI 투자를 위한 프레임워크가 필요하다는 관점

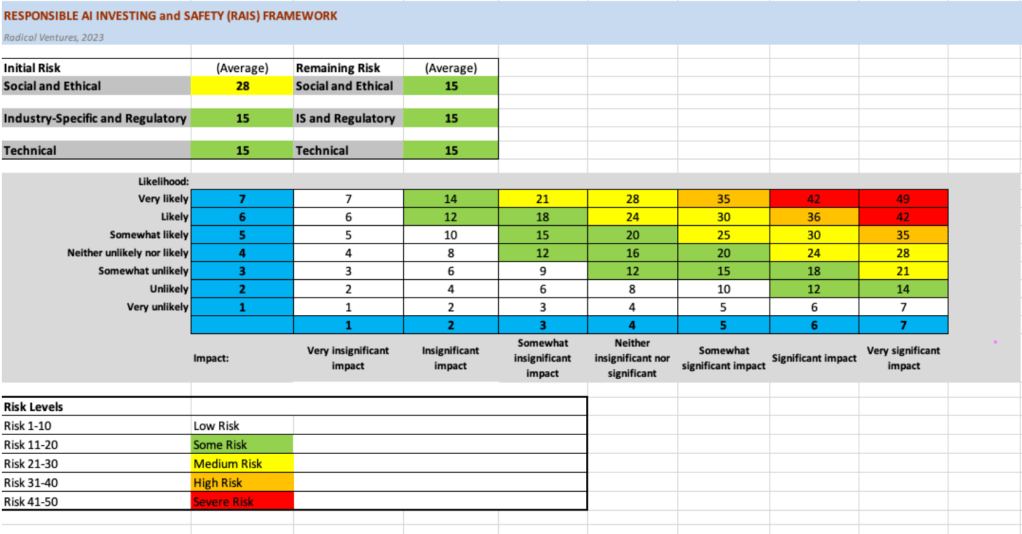

AI 중심 벤처 펀드인 Radical Ventures는 블로그를 통해 책임있는 AI 투자를 위한 VC의 프레임워크가 필요하다고 설명했다. VC의 투자가 현재의 AI 붐을 촉진하는데 중요한 역할을 했기 때문에, VC의 투자 의사결정과 이사회에서 내리는 결정들이 AI 기술을 통한 미래에 영향을 미칠것이라는 이유다.

따라서 자신들이 내부에서 DD와 투심 프로세스에 활용하는 것을 기반으로 Responsbile AI for Startups(RAIS) 프레임워크를 고안했다.

ⓒRadical Ventures

프레임워크에는 사회적/윤리적, 업계별/규제적, 기술적 위험 영역을 살펴보는 세션이 있다. 각 위험 영역마다 가능한 취약성 및 위협 유형에 대한 권장 사항 등을 수치화할 수 있다. Radical Ventures에서는 이를 체크리스트로 활용하기 보다는 투심위에서의 사고를 지원하고 체계화하는데 활용해야 한다고 설명하고 있다.

실사(Due Diligence)에서 AI ethics에 관한 검토

AI 거버넌스 어드바이저인 Sharma는 VC를 위한 AI 윤리 DD 질문지를 제공하고 있다. AI 윤리 문제는 차별, 개인정보 침해 등 알려진 문제를 넘어 작업및 결과에 대한 책임, 사회적 가치와의 일치, 유해콘텐츠 생성, 데이터 사용에 대한 투명성 등 광범위한 스펙트럼이 포함된다고 지적했다. 따라서 세계 경제에도 많은 영향을 미치며 AI 기업의 성장을 뒷받침한 벤처캐피탈이 포트폴리오 기업의 윤리와 거버넌스에 대해 올바른 질문을 해야한다는 것.

DD 질문의 사례를 번역한 내용은 다음과 같다.

AI Ethics Due Diligence Questionnaire for VCs

I. 일반 AI 윤리 : 회사 리더십 및 감독

– 회사 내에서 AI 윤리를 감독하는 책임자는 누구인가?

– 리더십팀은 AI 윤리 원칙을 입증 가능한 수준으로 이해하고 있나?

– 전담 AI 윤리 위원회나 팀이 있나? 있다면, 그 구성과 권한은 무엇인가?

II. 데이터 및 개인정보 보호

(1) 데이터 수집 및 사용

– 회사는 어떻게 사용자 데이터를 수집하고 보관하는가?

– 어떤 유형의 데이터가 수집되나(개인 정보, 민감한 데이터 등)?

– 데이터 수집의 법적 근거는 무엇인가(동의, 합법적 이익 등)?

– 사용자 동의는 어떻게 얻고 문서화하는가?

– 명확하고 접근 가능한 데이터 개인정보 보호정책이 있는가?

(2) 데이터 보안

– 사용자 데이터를 무단 접근, 사용 또는 공개로부터 보호하기 위해 어떤 조치가 마련되어 있나?

– 회사는 데이터 침해 및 사고를 어떻게 해결하는가?

– 정기적인 보안 감사와 침투 테스트를 실시합니까?

(3) 데이터 편향 및 공정성

-회사는 데이터 수집 및 알고리즘의 잠재적 편견을 어떻게 식별하고 완화하는가?

– 데이터 세트가 다양하고 의도된 사용자 기반을 대표하는가?

– 공정성 지표는 어떻게 평가되고 처리되는가?

(4) 데이터 소유권 및 투명성

– AI 시스템이 수집한 데이터의 소유자는 누구인가?

– 민감한 데이터를 무단 접근이나 오용으로부터 보호하기 위해 어떤 보안 조치가 마련되어 있는가?

– 사용자에게 자신의 데이터에 접근하고 이를 수정하거나 삭제할 권리가 있는가?

-회사에는 명확한 데이터 보존 및 삭제 정책이 있는가?

– 회사는 알고리즘 의사결정에서 투명성을 어떻게 보장하는가?

II. 알고리즘 설계 및 사용

(1) 설명 가능성 및 해석 가능성

– AI 시스템의 의사결정 과정을 인간이 이해할 수 있는 방식으로 설명할 수 있을까?

-회사에서는 시스템이 “블랙박스” 결정을 내리지 않도록 어떻게 보장하는가? (블랙박스 결정이란 AI 시스템이 그 추론 과정을 명확하게 이해하지 못한 채 출력/결정을 내리는 경우를 의미함)

(2)남용 가능성

-회사는 AI 시스템의 오용으로 인한 잠재적 위험(예: 차별, 조작)을 어떻게 평가하는가?

-이런 위험을 완화하기 위한 안전장치가 있는가?

-회사의 책임 있는 배포 및 모니터링에 대한 계획은 무엇인가?

-잠재적인 윤리적 문제를 해결하기 위한 명확한 지휘 계통이 있는가?

(3)인간의 감독 및 책임

– AI 개발 및 배포 프로세스에 인간의 감독이 어떻게 통합되는가?

– AI 시스템이 내리는 결정에 대한 책임은 누구에게 있는가?

-오류나 의도치 않은 결과를 해결하기 위한 프로세스는 무엇인가?

III. 사회적 및 사회적 영향

(1)영향 평가

-회사에서 AI 시스템의 잠재적인 사회적 영향에 대한 포괄적인 평가를 실시했는가?

– 회사는 잠재적인 부정적 영향을 어떻게 해결할 계획인가?

(2)가치와의 일치

– AI 시스템의 개발과 사용이 회사의 선언된 가치와 윤리 원칙과 어떻게 일치하는가?

(3)이해관계자 참여

-회사는 AI 윤리 문제에 관해 이해관계자(예: 사용자, 규제 기관)와 협력하는가?

– 회사는 이해관계자의 피드백을 AI 개발 프로세스에 어떻게 통합하는가?

IV. 추가 고려 사항

-회사에는 공개적으로 이용 가능한 AI 윤리 정책이나 원칙 선언문이 있는가?

-회사의 AI 개발이나 사용을 둘러싼 과거 윤리적 논란에 대한 문서화된 사례가 있는가?

Sharma의 포스팅에서는 (그리고 이미 ESG 붐 때 많은 연구들이 입증했던 것과 같이..) Economist Intelligence Unit의 설문 조사에 따르면, 임원의 90%가 책임 있는 AI 구현과 관련된 초기 비용보다 장기적 이점과 비용 절감이 더 크다고 동의한다는 내용을 전하고 있다.

그렇다. 그럴 수 있다. 오히려 ESG보다도 AI ethics는 그 파급력이 커서 장기적인 이점이 더 클 것이라는 생각도 든다. 그런데 실제로 투자시에 이런 부분을 고려해서 투자할 수 있을까? 불법 행위는 하지 않으면서도 인간의 본능적인 어떤 부분을 공략하여 매우 매출이 잘 나올만한 AI 기술이 있다면, 투자를 안할 수 있을까? 주주로서 이에 대해 문제를 제기할 수 있을까? 개인 투자자가 아닌 하우스에 속한 심사역이라면 어떨까? 나의 간접적 경험은 물론 주변에서 경험했다는 유사한 사례들을 살펴보면, 쉬운 문제는 아니라는 생각이 든다.

댓글 남기기